Sarsa

SARSA法

| 機械学習および データマイニング |

|---|

|

| |

SARSA法(State–Action–Reward–State–Action)はマルコフ決定過程でのポリシーを学習するためのアルゴリズムであり、機械学習のサブカテゴリーである強化学習の分野で使われる。RummeryとNiranjanのテクニカルノート[1]の中で、「Modified Connectionist Q-Learning(MCQ-L, 修正コネクショニストQ学習)」という名前で提案された。Rich Suttonにより提案された、「SARSA」という名前は、脚注で言及されるに留まった。

このネーミングは、Q関数の更新アルゴリズムが、現在の状況、現在の行動、行動による報酬、次の状態、その状態で選ぶ行動の5つ組で決まることに由来する。一般化すると、である[2]。なお、は報酬の定義によっては、とも書かれる。

アルゴリズム

状態 のエージェントが行動 を選び、報酬 を得て、状態が に遷移し、その次の行動が だとする。このとき行動価値関数 を次の式で更新する。 は に近づくように学習される。

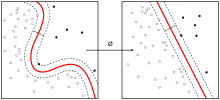

SARSAでは、エージェントは環境と相互作用し、行われた行動ベースでポリシーを更新する。そのため、オンポリシー型の学習アルゴリズムである。

学習率 は、古い情報を、新しく獲得した情報によってどの程度上書きするかを決定する。0にすれば、エージェントは何も学ばないし、1にすれば、最近の情報だけを近視眼的に考慮するようになる。

割引率 は、将来の報酬の重要度を決定する。0にすれば、エージェントは日和見主義的、近視眼的[3]になる。要するに、現在の報酬だけを考慮するようになる。1に近づければ、長期的視野で高い報酬を求めるようになる。1にしたり、1を超えたりすると、Q値は発散してしまう可能性がある。

関連項目

出典

SARSA

出典: フリー百科事典『ウィキペディア(Wikipedia)』 (2020/10/23 16:27 UTC 版)

SARSA(state–action–reward–state–action)は方策オン型のTD学習。 Q ( s t , a t ) ← Q ( s t , a t ) + α [ r t + 1 + γ Q ( s t + 1 , a t + 1 ) − Q ( s t , a t ) ] {\displaystyle Q(s_{t},a_{t})\leftarrow Q(s_{t},a_{t})+\alpha [r_{t+1}+\gamma Q(s_{t+1},a_{t+1})-Q(s_{t},a_{t})]}

※この「SARSA」の解説は、「強化学習」の解説の一部です。

「SARSA」を含む「強化学習」の記事については、「強化学習」の概要を参照ください。

- sarsaのページへのリンク

![{\displaystyle Q(s_{t},a_{t})\leftarrow (1-\alpha )Q(s_{t},a_{t})+\alpha \left[r_{t}+\gamma \,Q(s_{t+1},a_{t+1})\right]}](http://weblio.hs.llnwd.net/e7/img/dict/wkpja/https://wikimedia.org/api/rest_v1/media/math/render/svg/8988ee20ebf7380f46a0aed4b9c23dafe704f6db)